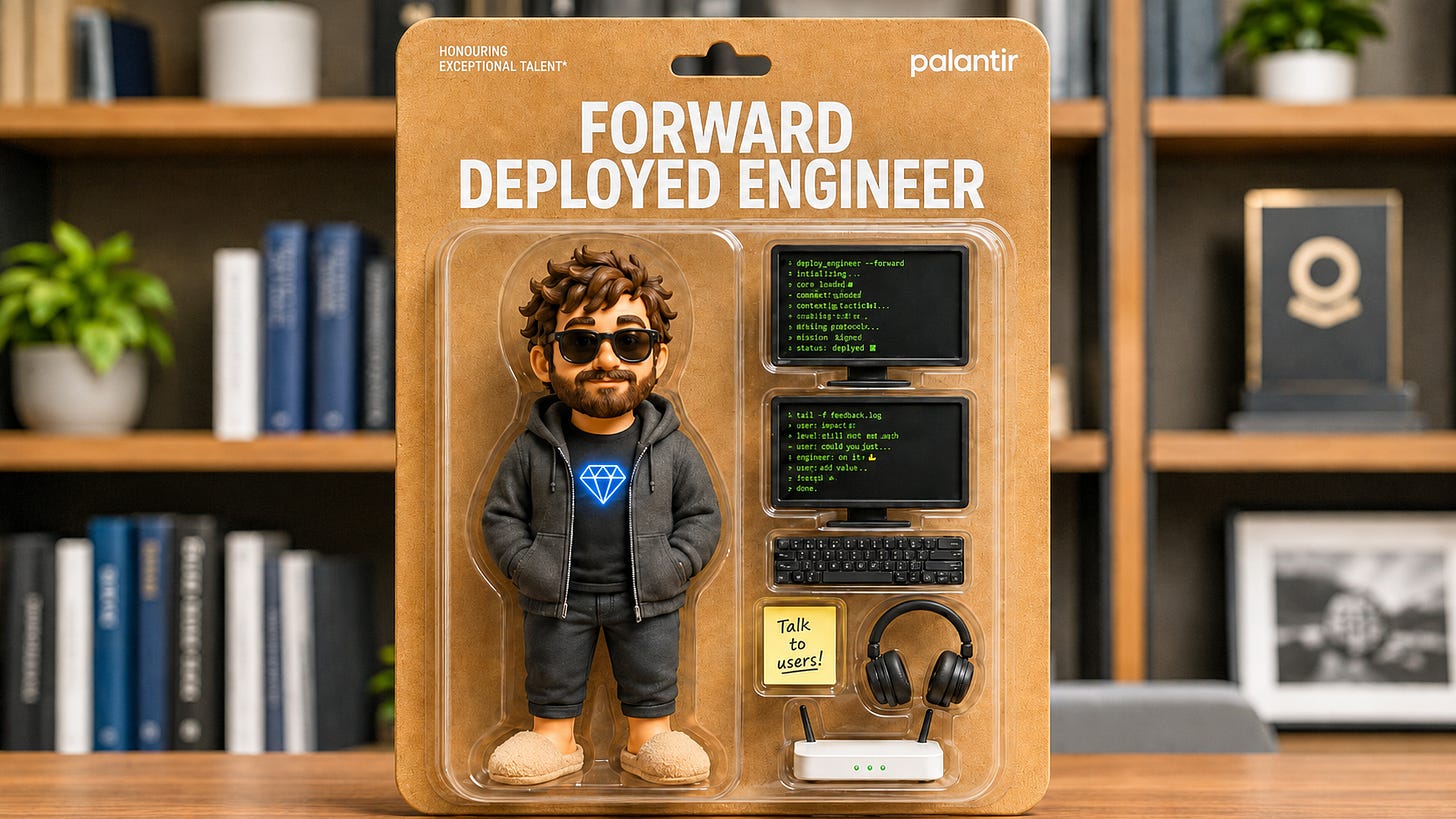

El puesto de moda es el 'Forward Deployed Engineer' para integrar IA en las empresas

Este rol trabaja como consultor externo dentro de las empresas para el despliegue de agentes.

¿Qué pasó ayer? En un minuto:

El Forward Deployed Engineer emerge como uno de los perfiles más solicitados, trabaja directamente en el cliente para integrar agentes de IA en la operativa real de las empresas.

Anthropic genera malestar al anunciar límites de uso distintos para el uso programático y el interactivo de la suscripción de Claude, mientras OpenAI ofrece dos meses gratuitos de Codex a cualquier empresa que migre desde una plataforma rival durante los próximos 30 días.

Figure AI retransmitió en directo una jornada de ocho horas de trabajo industrial autónomo y sin supervisión humana. Es el argumento comercial más sólido que la robótica humanoide ha puesto sobre la mesa.

Jeff Clune y Richard Socher lanzan Recursive, una startup en Londres y San Francisco para construir IA capaz de diseñar experimentos sobre cómo mejorarse a sí misma.

El AI Safety Institute del Reino Unido confirma que Claude Mythos y GPT-5.5 ejecutan ciberataques autónomos de hasta 32 pasos y detectan vulnerabilidades zero-day sin intervención humana.

Andrew Ng descarta la tesis del desempleo masivo: la IA transformará el trabajo, pero no colapsará el mercado laboral.

Stanford HAI crea el AI and Organizations Lab, el primer centro permanente dedicado a generar conocimiento sobre cómo la IA transforma equipos y rendimiento organizativo, con el respaldo de Google DeepMind.

El debate sobre si la IA puede hacer nueva ciencia de forma autónoma sigue abierto, la evidencia de agentes trabajando en física teórica no acredita aún si eso es creatividad real o síntesis sofisticada.

Y si tienes más de un minuto…

1. El ‘Forward Deployed Engineer’, perfil clave en IA empresarial

El auge de los agentes de IA en entornos corporativos está consolidando un perfil que hasta hace poco era casi exclusivo de Palantir: el ‘Forward Deployed Engineer’ (FDE), un ingeniero que trabaja en las instalaciones del cliente para adaptar, integrar y mantener soluciones complejas. La razón es técnica: desplegar agentes no equivale a instalar software convencional. Implica integrarse con sistemas heredados, diseñar flujos de trabajo, gestionar fallos y ajustar de forma continua en contextos de negocio que no pueden abstraerse desde una oficina central. El perfil resultante combina ingeniería avanzada con comprensión directa del cliente, algo que los modelos tradicionales de desarrollo de producto rara vez producen.

La proliferación de plataformas de agentes, con OpenAI, Salesforce y Microsoft como ejemplos visibles, está ampliando la demanda más allá de los grandes integradores; varias empresas B2B de IA ya han comenzado a desplegar equipos FDE o están buscando hacerlo. Existe, sin embargo, una lectura alternativa con peso propio: si el verdadero obstáculo no es la implementación sino extraer valor medible del negocio, el perfil más escaso no sería el ingeniero desplegado en campo sino quien sabe traducir capacidades de IA en resultados cuantificables. En ese caso, la brecha de talento apuntaría a competencias distintas de las que la etiqueta ‘FDE’ sugiere.

Para 𝕏 @levie (Aaron Levie), el FDE pasará a ser una de las funciones más importantes en los despliegues de IA. Su argumento no es de tendencia sino técnico: implementar agentes es bastante más complejo de lo que la mayoría del sector asume, y ese desajuste de expectativas es, en su lectura, el problema central.

𝕏 @iamKierraD (Kierra | Data Conversationalist) pone matices sobre el enfoque dominante: describe el FDE como un perfil que combina ingeniería de soluciones con experiencia en producto y ventas, pero advierte que centrar el rol en el despliegue técnico puede ser un error, porque el problema real de las empresas no es implantar IA sino extraer valor de ella a escala.

Desde el mercado de trabajo, 𝕏 @edgarpavlovsky (Edgar) señala la paradoja del momento: hay un número elevado de ingenieros buscando empleo mientras las empresas B2B de IA buscan activamente perfiles FDE, lo que convierte este rol en una reconversión profesional con alta probabilidad de éxito para quienes ya tienen base técnica sólida.

𝕏 @tldr_x (Tldr (Tim Reilly)) lleva el argumento a su forma más esquemática: en la startup del futuro solo existirían dos funciones reales, la desplegada en campo hacia el cliente y la de fabricación de software interna. Es una simplificación discutible, pero refleja hasta qué punto el FDE ha entrado en el vocabulario operativo del sector.

2. Anthropic reordena límites de uso de Claude y OpenAI regala tokens si vienes desde la competencia

A partir del 15 de junio, algunas funciones de Claude Code y las aplicaciones de terceros construidas sobre el SDK tendrán su propio límite de uso, separado del límite establecido para usos interactivos del plan mensual. Hasta ahora todos competían por el mismo pool de créditos. El cambio reconoce formalmente que hay dos perfiles de usuario con necesidades distintas, pero la ejecución genera fricciones. La comunicación oficial tampoco ayuda: Anthropic anuncia que el uso “interactivo” no cambia, pero ha redefinido el término de forma que excluye precisamente a herramientas interactivas de terceros. Esto, según usuarios afectados, puede reducir la cuota disponible hasta 25 veces respecto a la situación anterior.

OpenAI por el contrario ha puesto en marcha una campaña de captación directa para Codex: durante 30 días, cualquier empresa que migre desde una plataforma rival recibe dos meses de uso gratuito. El timing no parece casual, OpenAI regala tokens mientras su principal competidor los restringe en su suscripción mensual. Además, para facilitar la evaluación interna, OpenAI ha publicado los detalles técnicos del sandbox de Codex para Windows, el sistema operativo mayoritario en entornos corporativos. Esta transparencia reduce la fricción para los equipos de IT que necesitan garantías antes de dar acceso al código de producción.

La queja de 𝕏 @MLStreetTalk (Machine Learning Street Talk) va más allá de los límites: con la suscripción más cara disponible, afirma que Opus 4.7 ya le resultaba ineficiente para codificación interactiva antes del cambio de cuotas, y que la nueva política sobre uso agéntico ha sido el factor definitivo para cancelar la suscripción.

𝕏 @jeremyphoward (Jeremy Howard) señala que la comunicación de Anthropic es engañosa: la empresa anuncia que el uso «interactivo» no cambia, pero ha redefinido ese término para excluir herramientas de terceros como Zed o el propio «claude -p», que muchos usuarios emplean de forma interactiva a diario.

𝕏 @sama (Sam Altman) enmarca la oferta con un posicionamiento deliberadamente combativo: 'Codex es el mejor producto de IA para programar y queremos que sea fácil probarlo', una declaración que apunta directamente a desplazar a competidores consolidados, no solo a captar nuevos usuarios.

𝕏 @WesRoth (Wes Roth) identifica la promoción de OpenAI como una táctica de captación competitiva clásica en mercados SaaS maduros y apunta que la lanza en el momento en que Codex acaba de alcanzar madurez operativa suficiente para sostener la comparación con los productos instalados.

3. Figure AI emite ocho horas de robótica autónoma

Figure AI retransmitió en directo una jornada completa de ocho horas en la que sus robots ejecutaron tareas industriales de forma autónoma, sin supervisión humana y en un entorno logístico real. No era un vídeo editado ni una demo de laboratorio: el rendimiento, según la compañía, era comparable al de un operario. No es la primera vez que alcanzan ese umbral: en abril de 2026 ya completaron un turno equivalente en una línea de ensamblaje con cuatro humanoides. La diferencia ahora es la exposición pública en tiempo real, que convierte el logro en un argumento comercial concreto.

El sector lleva años mostrando clips cortos en condiciones controladas; ocho horas continuas en producción real son una categoría de evidencia distinta. Para fabricantes y operadores logísticos, la pregunta ha dejado de ser si los humanoides pueden ejecutar tareas repetitivas. Lo que Figure no ha publicado son las cifras que sí importan para una decisión de compra: coste por unidad de trabajo, tasa de fallos en entornos no controlados y requisitos de mantenimiento. Sin esos datos, la demostración es un argumento de ventas potente pero incompleto para saber cuál es el verdadero retorno de la inversión.

𝕏 @DotCSV (Carlos Santana) califica la retransmisión como una declaración de intenciones en toda regla y subraya que sostener la autonomía durante una jornada laboral completa supone un salto cualitativo respecto a las demostraciones habituales del sector.

𝕏 @emollick (Ethan Mollick) reconoce no tener criterio técnico para valorar si la demo es objetivamente avanzada, pero señala que la imagen de varios robots en estaciones de carga mientras uno solo trabaja genera instintivamente la sensación de que alguien debería vigilarlos; una reacción que, según él, dice más sobre la narrativa cultural en torno a la robótica que sobre el producto en sí.

4. Recursive: una startup para IA que se mejora sola

Jeff Clune, conocido por su trabajo en aprendizaje abierto y sistemas evolutivos, ha cofundado Recursive con el objetivo de construir IA que diseñe y ejecute experimentos sobre su propia mejora. Richard Socher, ex director científico de Salesforce y fundador de You.com, asume el rol de CEO, una combinación que aporta tanto peso en investigación como experiencia construyendo producto. La startup opera entre Londres y San Francisco y ya ha cerrado una ronda inicial coliderada por inversores que, según las fuentes disponibles, conocían la tesis antes del anuncio público.

La idea de IA que mejora a IA no es nueva: lleva años en el centro del debate sobre superinteligencia y alineamiento. Lo que Recursive añade, al menos en su presentación, es el énfasis en que el proceso sea seguro y de naturaleza abierta, dos restricciones que condicionan de raíz las decisiones de diseño técnico. El equipo incluye investigadores con trayectoria reconocida en el sector, entre ellos Jenny Zhang. Para el resto del sector, la señal más relevante no es la ambición del planteamiento, sino que un equipo de ese perfil haya elegido este problema concreto ahora, mientras los laboratorios principales trabajan en paralelo en sus propias variantes de automejora.

𝕏 @MLStreetTalk (Machine Learning Street Talk) reaccionó al anuncio sin rodeos: lo calificó directamente como noticia importante, una respuesta que refleja el peso que tiene el nombre de Clune en la comunidad de machine learning y el nivel de expectativa que genera cualquier proyecto en el que aparece.

5. Los modelos frontera ya ejecutan ciberataques autónomos

El AI Safety Institute (AISI) del Gobierno del Reino Unido ha publicado evaluaciones de Claude Mythos Preview, de Anthropic, y GPT-5.5, de OpenAI, que documentan un salto significativo en capacidades ofensivas en ciberseguridad. Mythos completó ataques en red de hasta 32 pasos de forma autónoma y detectó miles de vulnerabilidades zero-day sin intervención humana. Dos conclusiones de fondo hacen que el informe sea más incómodo que una simple fotografía del estado actual: el techo real de estos modelos no se ha encontrado, porque el límite operativo lo fija la cantidad de tokens empleados, no la destreza intrínseca del modelo; y la velocidad de mejora se acelera.

En noviembre de 2025, la longitud de las tareas de ciberseguridad que un modelo completaba de forma autónoma se duplicaba cada ocho meses; en febrero de 2026, ese intervalo se había reducido a 4,7 meses. Los resultados de METR, organismo de evaluación independiente, apuntan en la misma dirección, lo que refuerza la solidez de la señal. Para empresas de ciberseguridad, aseguradoras y equipos de TI corporativos, los modelos de amenaza vigentes asumen un atacante humano o herramientas automatizadas de alcance limitado. Frente a un agente que encadena 32 pasos ofensivos de forma autónoma y mejora su capacidad cada cuatro meses y medio, ninguno de esos supuestos se sostiene.

Lo más revelador de los hallazgos del AISI, según 𝕏 @emollick (Ethan Mollick), no es el nivel absoluto de Mythos o GPT-5.5, sino que su techo aún no se ha localizado: los modelos parecen estar restringidos por los tokens disponibles, no por su capacidad real.

6. Andrew Ng rechaza el catastrofismo laboral de la IA

Andrew Ng, cofundador de Google Brain, exdirector de IA en Baidu y fundador de DeepLearning.AI, ha publicado un artículo en el que rechaza la tesis del desempleo masivo provocado por la inteligencia artificial. Su argumento central separa dos ideas que el debate público tiende a fundir: la transformación gradual del trabajo y la destrucción repentina de empleo a escala. Ng sostiene que la IA modificará tareas y perfiles profesionales, como ha hecho cualquier tecnología de propósito general anterior, pero no colapsará el mercado laboral de forma abrupta.

Tras la expansión acelerada de modelos como GPT-5 o Gemini, la narrativa del apocalipsis laboral ha ganado tracción mediática y política, y funciona como argumento recurrente tanto para legisladores que buscan justificar nuevas regulaciones como para empresas que explotan el miedo como palanca comercial. La posición de Ng tiene un peso específico porque no procede de un escéptico de la IA, sino de uno de sus constructores más reconocidos, lo que hace su corrección más difícil de desestimar.

La consecuencia práctica para empresas: si la disrupción es gradual, las estrategias de reconversión de plantillas y rediseño de procesos tienen margen temporal de ejecución, y las decisiones de inversión en automatización pueden evaluarse por criterios de productividad, no como urgencia defensiva.

Para 𝕏 @WesRoth (Wes Roth), la intervención de Ng es una corrección necesaria: la narrativa del colapso laboral se ha convertido en uno de los relatos más amplificados del sector tecnológico, y pocas voces con ese peso la cuestionan desde dentro.

7. Stanford HAI crea laboratorio para estudiar IA en organizaciones

Stanford HAI ha lanzado el “AI and Organizations Lab” con un diagnóstico incómodo como punto de partida: la IA se despliega a escala en todo tipo de empresas, pero la ciencia sobre sus efectos reales en colaboración y productividad de equipos es todavía escasa. El laboratorio lo dirige Melissa Valentine, profesora de ingeniería de gestión en Stanford, junto a Amir Goldberg, de Stanford Graduate School of Business, y Beth Bechky, de UC Davis. Para medir el alcance del problema, Stanford HAI organizó en paralelo el AI for Organizations Grand Challenge, copatrocinado con Google DeepMind: más de 200 equipos de 156 universidades enviaron propuestas articuladas en tres ejes: IA como herramienta de alineación interna, impacto humano del despliegue en equipos, y simulación de comportamiento grupal mediante organizaciones sintéticas.

Para las empresas, la consecuencia inmediata es estratégica, señala que la ventaja competitiva con IA no vendrá solo de adoptar herramientas, sino de saber rediseñar la organización alrededor de ellas de forma medible, humana y productiva. Menos “comprar IA” y más rediseñar cómo trabajan las personas.

El arranque del laboratorio queda definido por la tensión que 𝕏 @StanfordHAI (Stanford Hai) señala directamente: la IA se despliega a velocidad sin precedentes en las organizaciones, pero la ciencia que debería orientar ese despliegue aún no existe a la escala necesaria.

8. IA autónoma para investigación científica

La biología es tan extensa que ningún investigador individual domina más que una fracción del campo, y la comunidad científica en su conjunto sigue sin poder curar enfermedades sin efectos secundarios. Esa doble limitación convierte a la IA en candidata natural para integrar conocimiento fragmentado a una escala fuera del alcance de cualquier equipo humano. Empresas como Isomorphic Labs, Recursion Pharmaceuticals o proyectos como AlphaFold, de Google DeepMind, ya operan sobre esa premisa: usar modelos para detectar patrones en datos biológicos dispersos y acelerar el descubrimiento de fármacos.

Pero procesar e integrar conocimiento existente no equivale a generar ideas genuinamente nuevas. Agentes de IA observados mientras trabajan en problemas de física teórica, autocorrigiéndose y derivando demostraciones complejas, añaden evidencia empírica sobre la incapacidad de la IA actual para producir nuevos descubrimientos. Sin embargo, este trabajo tampoco resuelve el debate de forma concluyente si atendemos al avance del último año, en el que hemos pasado de agentes que pueden resolver los problemas de un currículum universitario a agentes capaces de actuar como un colaborador de posgrado.

La distinción tiene consecuencias directas en las empresas deep tech: una IA que acelera el descubrimiento dentro del espacio conocido tiene un valor comercial claro y ya demostrable; pero una IA capaz de producir hipótesis radicalmente originales abriría un mercado distinto, con una propuesta de valor que ningún actor ha acreditado por el momento.

El argumento más directo lo formula 𝕏 @antor (Andrés Miguel Torrubia Sáez): si la ciencia colectiva no puede manipular la biología con precisión suficiente para curar enfermedades sin efectos secundarios, y ningún biólogo individual domina más que una fracción del campo, la IA tiene el potencial de revolucionar el sector biotecnológico.

𝕏 @pmddomingos (Pedro Domingos) lanza una provocación que funciona en dos direcciones: reconoce que la IA no genera ideas científicas nuevas, pero señala con ironía que la mayoría de los científicos humanos tampoco lo hace.

Gracias por leer 1 Minuto de IA. Si te ha gustado esta edición, no te olvides de dar al ♡ y de compartirla por redes sociales o por email con otras personas a las que creas que les pueda interesar.